Por Enio Klein

Ao longo do século XX, a ficção científica foi muito além do entretenimento. Autores como Aldous Huxley, George Orwell e Ray Bradbury construíram visões de mundo que não eram tanto previsões tecnológicas, mas advertências filosóficas. Eles imaginaram sociedades onde o avanço técnico não se traduziu em liberdade ou progresso humano, mas em dominação sutil, obediência voluntária e alienação cultural. Hoje, em meio ao avanço acelerado da inteligência artificial, suas obras soam menos como ficção e mais como espelhos incômodos da realidade que estamos ajudando a construir.

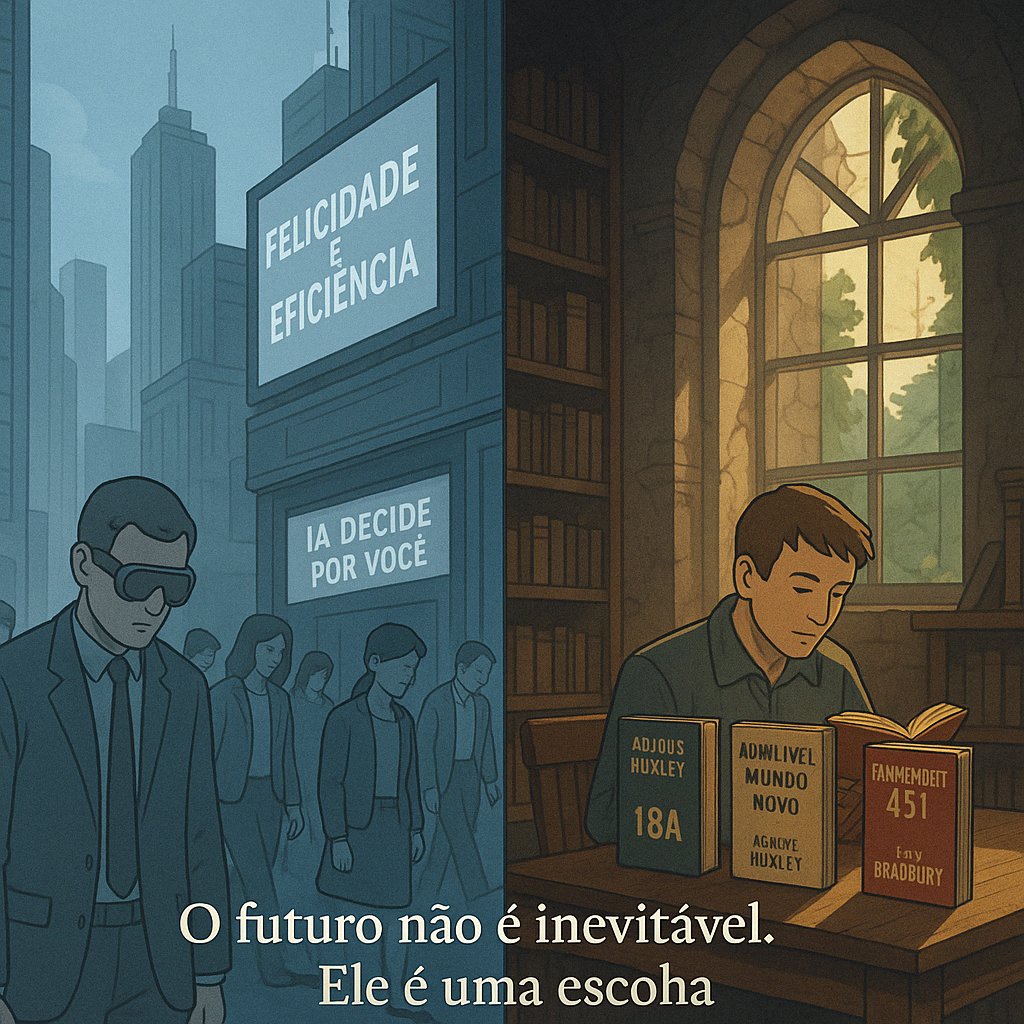

Em Admirável Mundo Novo, Huxley desenhou uma sociedade em que a busca por prazer e eficiência aboliu o pensamento crítico. A tecnologia, usada para satisfazer desejos instantâneos, tornou desnecessária a rebeldia — e até o desconforto da reflexão. Já Orwell, em 1984, projetou um mundo onde a vigilância é total e a manipulação da linguagem apaga a possibilidade de resistência. A informação é controlada para moldar comportamentos e reprimir a individualidade. Bradbury, por sua vez, em Fahrenheit 451, alertou sobre uma cultura que despreza os livros, a dúvida e a complexidade — substituindo tudo isso por entretenimento superficial, padronizado e automático.

Esses autores falavam sobre futuros possíveis, mas suas críticas tinham endereço claro: o presente. E hoje, diante do avanço da inteligência artificial, suas mensagens se tornam ainda mais urgentes. Especialistas e fornecedores de tecnologia não escondem o entusiasmo: a IA vai substituir empregos, tomar decisões por nós, prever comportamentos, automatizar tudo. Em troca, prometem produtividade, eficiência e uma “experiência do usuário” perfeita. Mas em meio a esse entusiasmo, onde fica o espaço para a humanidade?

A pergunta central é: a que custo? Será que estamos prontos para abdicar da subjetividade, da intuição, da dúvida? Ao colocar algoritmos no centro da tomada de decisão — treinados por dados que refletem interesses econômicos e vieses sociais —, não estaríamos entregando nossas escolhas mais fundamentais a sistemas que não compreendemos, nem governamos? E mais: será que essa transferência de poder não está criando um novo tipo de controle — mais silencioso, mais conveniente, mas igualmente eficaz?

A promessa da IA não é, por si só, o problema. O problema é a ausência de crítica, regulação e responsabilidade coletiva. Em um mundo que celebra o desempenho e a automação, o risco é que percamos de vista aquilo que nos torna humanos: a imperfeição criativa, a dúvida honesta, a escolha ética. O desafio não é apenas técnico — é moral, político e cultural. Estamos moldando uma sociedade onde a eficiência vale mais que a liberdade? Onde o conforto vale mais que a autonomia?

Se não formos cuidadosos, poderemos olhar para trás e perceber que o futuro que rejeitamos nas páginas da ficção acabou se infiltrando sorrateiramente nas engrenagens da realidade. E o mais preocupante: não haverá um tirano explícito para culpar, apenas nós mesmos — e nossa complacência diante do conforto algorítmico.

Não precisamos do Matrix, mas estamos arriscando construí-lo — tijolo por tijolo, aplicativo por aplicativo, decisão por decisão. A inteligência artificial pode ser uma aliada poderosa, mas só se for guiada por valores humanos, por regulação ética e por uma sociedade consciente de que a tecnologia existe para nos servir — e nunca para nos substituir. O futuro não é inevitável. Ele é uma escolha. E está sendo feita agora.